Streszczenie

Kilka miesięcy temu brałem udział w wyzwaniu społeczności zatytułowanym „Creep it Real”, które zostało zorganizowane przez Epic Games. Wyzwanie polegało na stworzeniu sceny wewnątrz silnika Unreal Engine, która wpisywałaby się w temat wyzwania. Mój projekt został wyróżniony, więc postanowiłem podzielić się z Wami przebiegiem tego przedsięwzięcia. Może część z Was dowie się czegoś nowego lub interesującego, albo otrzyma odpowiedzi na nurtujące pytania.

Zasady wyzwania

Uczestnik miał mniej więcej miesiąc na wykonanie zadania i mógł korzystać tylko z silnika graficznego Unreal Engine. Miał również dostęp do Unreal Marketplace, gdzie można znaleźć płatne i bezpłatne produkty stworzone przez społeczność, w tym dźwięki, modele 3D i gotowe projekty. Aby ukończyć scenę, należało także przygotować film trwający nie dłużej niż 1 minutę, który mógł zostać stworzony tylko za pomocą narzędzia Sequencer w silniku.

Przygotowanie materiałów

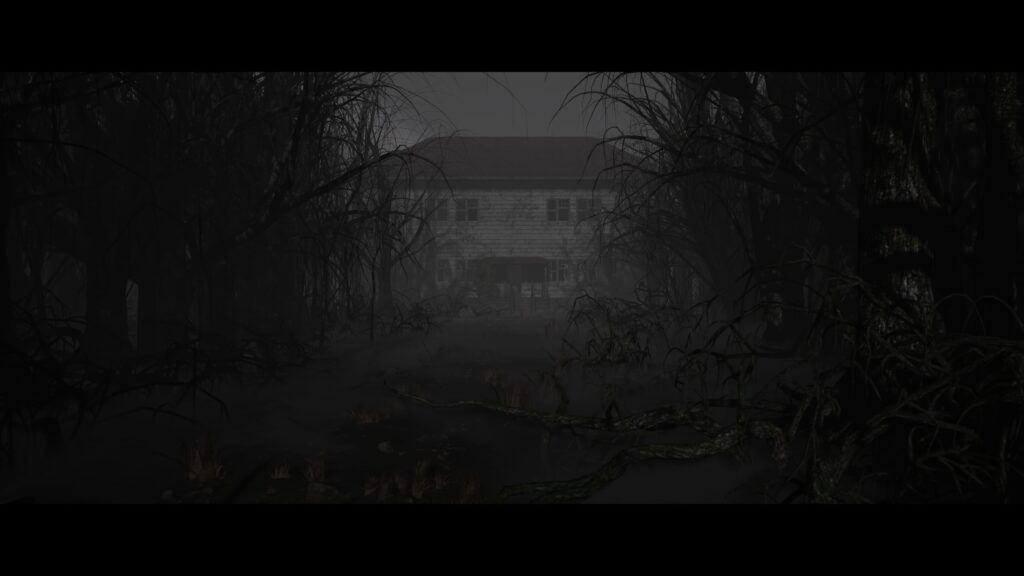

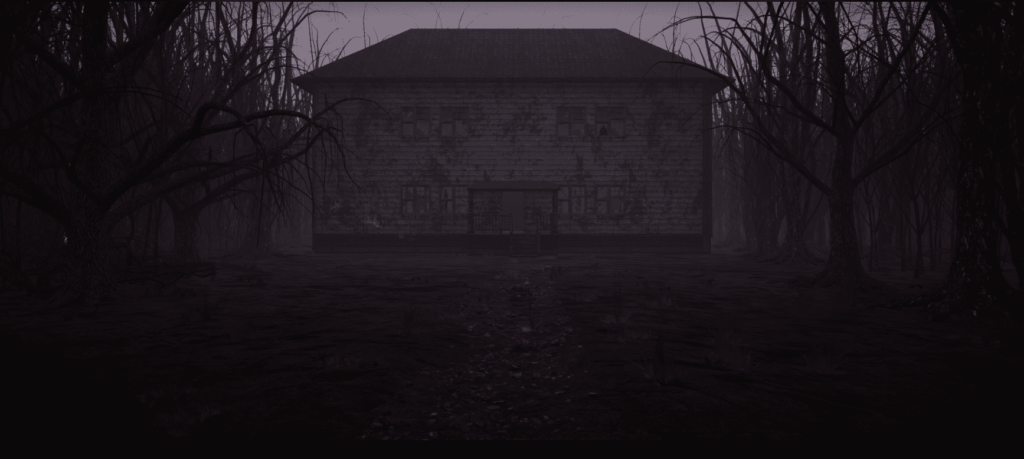

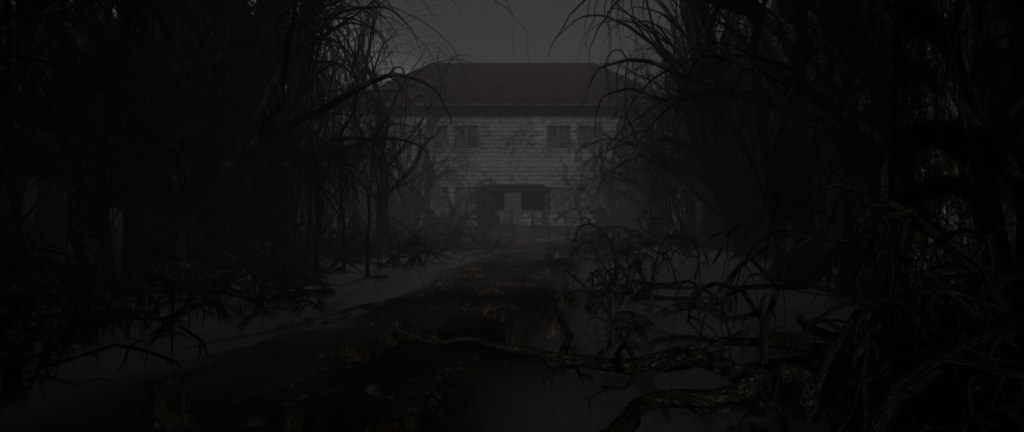

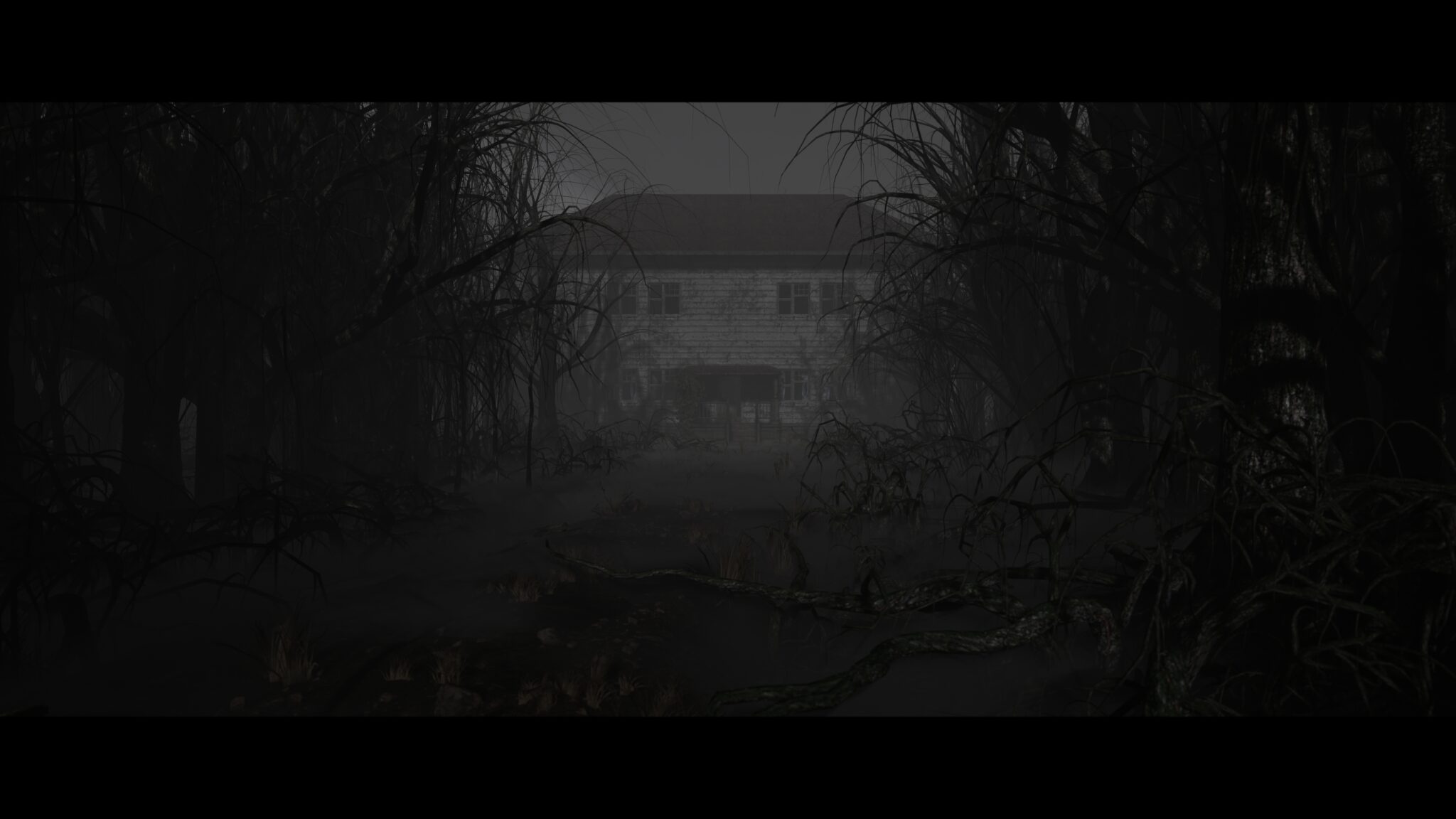

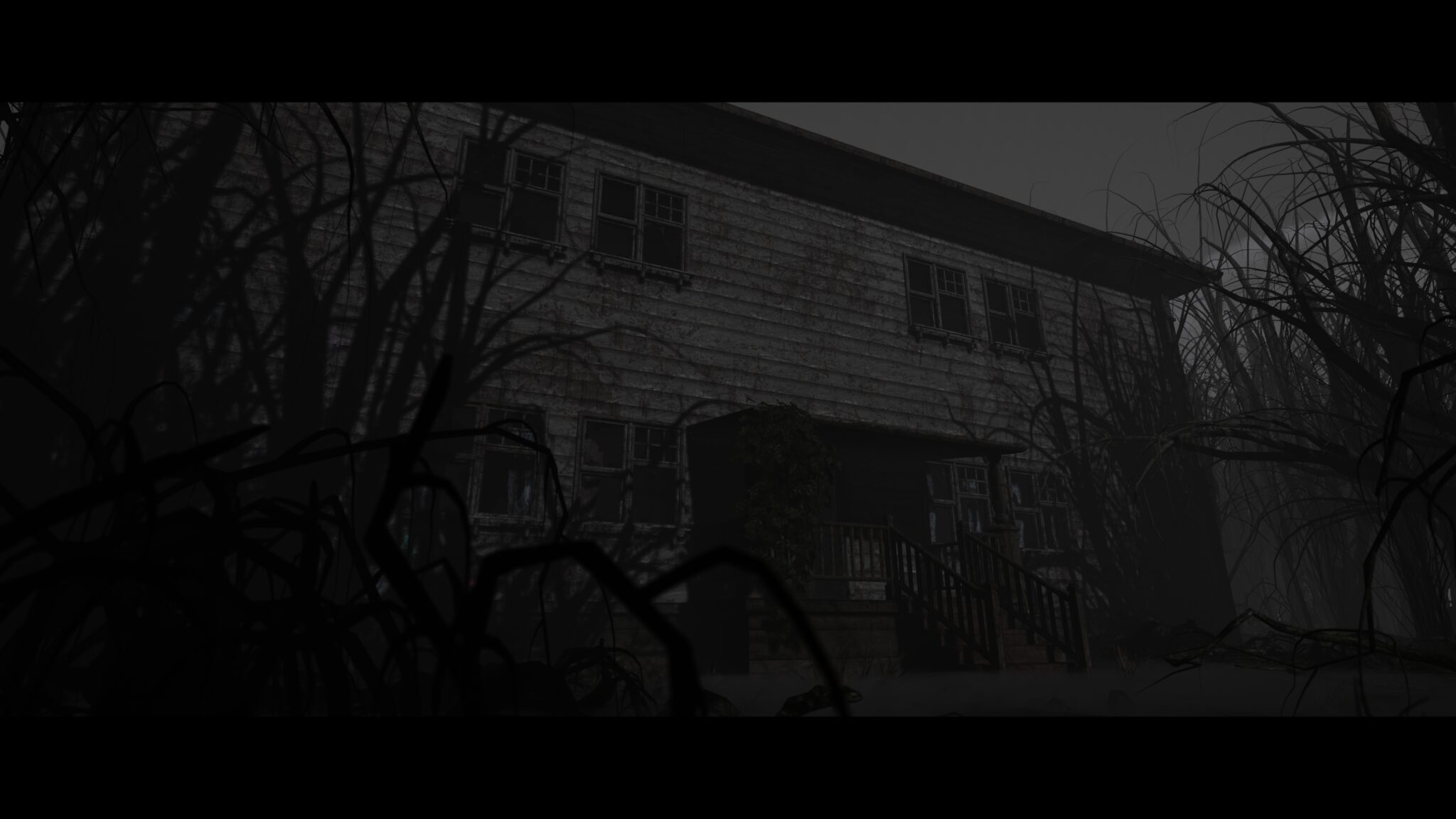

Przystępując do pracy, miałem w głowie wizję starego domu pośrodku mrocznego lasu. Dlatego przeszukałem swoją kolekcję assetów w poszukiwaniu odpowiednich modeli i wybrałem następujące z ponad 440 dostępnych produktów:

- Post Apocalyptic City

- Dark Forest

- FluidNinja VFX Tools

- Puppet

- ANIMAL VARIETY PACK

- Valley of the Ancient

- Horror Game Sound Effects

- Immersive Dark Ambient Music Pack

W trakcie tworzenia nie wiedziałem już, co mogłoby ulepszyć scenę, ale na szczęście pomógł mi w tym pewien program.

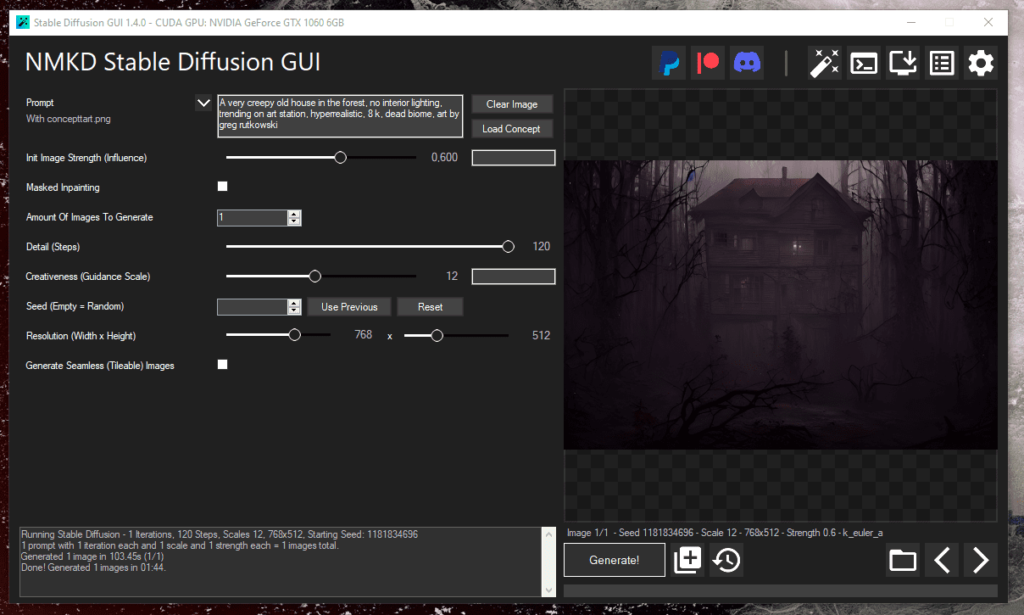

Stable diffusion, sztuczna inteligencja która wygeneruje dla ciebie Concept Art.

Zdecydowałem się na wykorzystanie nowoczesnej technologii generowania obrazów przez sztuczną inteligencję. Zaimportowałem wyżej wspomniane zdjęcie do programu Stable diffusion GUI, wprowadziłem kilka popularnych promptów, a następnie przesunąłem kilka suwaków zgodnie z poradnikiem na YouTube.

Konkluzja z użytkowania stable diffusion

Narzędzie jest bardzo pomocne, biorąc pod uwagę, że nie potrafię rysować, szkicować ani malować. Generowanie concept artów zajęło raptem kilka minut, było darmowe i co najważniejsze, pokazało mi szczegóły, których wcześniej nie zauważyłem.

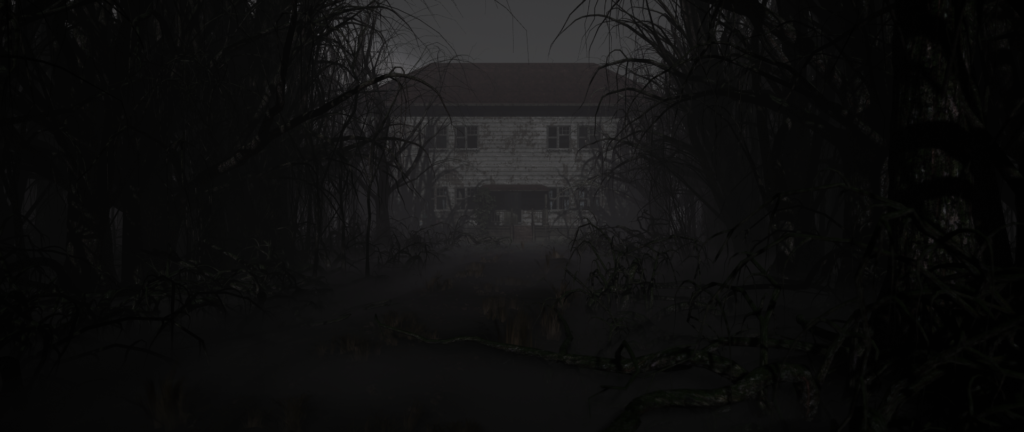

Na wygenerowanym zdjęciu widać, że pomiędzy kamerą a domem nie ma pustej przestrzeni – są za to pnie, gałęzie i różnego rodzaju elementy wypełniające, które nadają scenie dodatkowego realizmu.

Kolejny etap projektu

Wziąłem pod uwagę sugestie sztucznej inteligencji i dodałem brakujące elementy. Zaimplementowałem więcej drzew po obu stronach ścieżki, stworzyłem zagłębienia w terenie po obu stronach ścieżki i dodałem do nich gałęzie oraz pnie drzew. Efekt był zaskakująco dobry, ponieważ elementy zasłoniły najsłabsze miejsca na scenie i pozwoliły osiągnąć wyższy poziom realizmu niż początkowo zakładałem.

Sequencer

Mając już gotową scenę, przystąpiłem do tworzenia filmiku w Sequencerze. Nie będę się tu rozdrabniał, za to podam linki do filmów na YouTube, z których korzystałem:

- Tutorial: Create Dolly Zoom / Vertigo Effect in Unreal Engine (featuring Metahuman)

- [UE5] HOW TO use SEQUENCER and SET UP SCENE in Unreal Engine 5 | [ UE5 TUTORIAL SERIES ]

- 5. Blending Animation Clips with Sequencer

- Slay Workflow 6: Sequencer | Unreal Engine

- How I get UNREAL ENGINE to look like a movie | FULL BREAKDOWN

Legancko Robert Dobra robota, tylko mam wrażenie że na tym filmiku ta mgła się zacinała coś jakby się źle zrenderowało cos albo nie wiem xd. Ale i tak jestem pod wrażeniem. 3mam kciuki za Ciebie pozdro

Cześć Błażej! Efekt „Zacinania” jest spowodowany kompresją filmu przez youtube który niemiłosiernie potratktował mój twór. Ten efekt jest bardzo dobrze wytłumaczony w tym filmie Toma Scotta: https://www.youtube.com/watch?v=h9j89L8eQQk